Der Engpass der KI liegt im Betrieb

Viele Unternehmen erwarten von KI-Agenten einen Produktivitätssprung. In der Praxis liegt die Bremse oft woanders: im Betrieb selbst. Daten hängen unverbunden nebeneinander, Kontext fehlt, Geschäftsregeln sind nur teilweise beschrieben. Ob die nächste Stufe der Automatisierung gelingt, entscheidet sich daher kaum allein an größeren Modellen. Entscheidend ist, wie präzise ein Unternehmen seine eigene betriebliche Wirklichkeit beschrieben hat. Wo Prozesse, Zuständigkeiten und Abhängigkeiten unscharf bleiben, wird aus KI kein operatives System, sondern ein Werkzeug mit begrenztem Verständnis.

Die KI-Branche beherrscht die Kunst, technische Fortschritte wie betriebliche Zäsuren erscheinen zu lassen. Zuerst sollte das Sprachmodell den Analysten verdrängen, dann sollte der Agent das Datenproblem lösen. Inzwischen liegt die Schwachstelle offener zutage. Ein Datenagent ohne belastbaren Zusammenhang ist kein digitaler Mitarbeiter. Er klingt überzeugend. Er versteht zu wenig. Er antwortet schnell, formuliert glatt und scheitert dort, wo Unternehmen genau sein müssen: bei Definitionen, Zuständigkeiten und bei der Frage, welche Zahl im Zweifel gilt.

Das ist längst keine theoretische Reserve mehr. OpenAI hat GPT-5.4 Anfang März mit einem Kontextfenster von bis zu einer Million Token sowie stärkerer Werkzeugsuche und Computersteuerung vorgestellt. Die Richtung ist eindeutig: Systeme sollen längere Zusammenhänge, Werkzeuge und Arbeitsschritte konsistent verarbeiten. Gerade darin liegt ein wichtiger Hinweis. Je näher KI an reale Arbeitsabläufe rückt, desto wertvoller wird Kontext.

Wenn Daten keine Bedeutung tragen

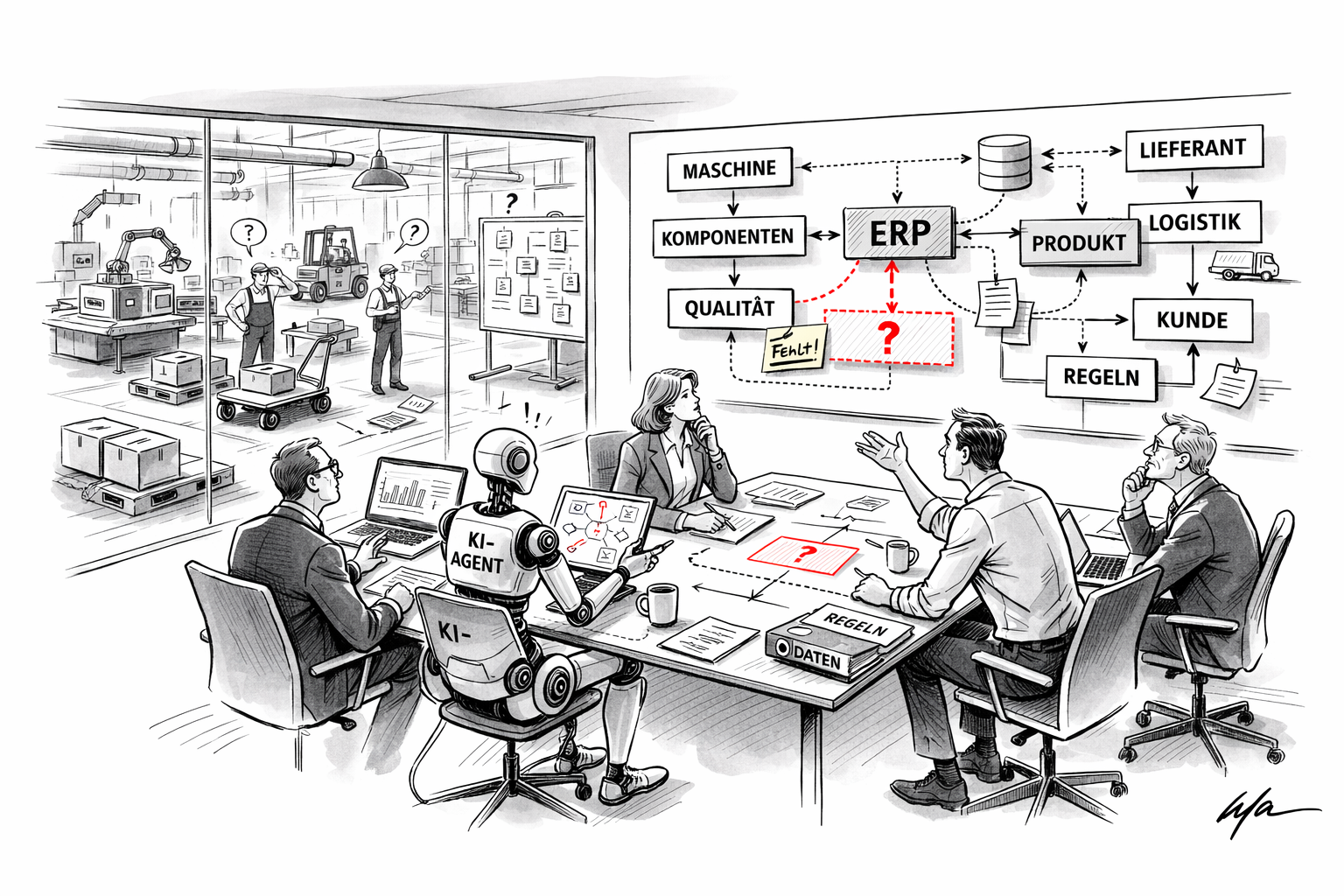

Daten haben viele Unternehmen genug. Oft sind sie auch brauchbar. Was fehlt, ist der Zusammenhang im Betrieb. Das ERP kennt Aufträge, Stücklisten und Bestände. Die Produktionssteuerung kennt Maschinen, Taktzeiten und Auslastung. Das CRM kennt Kunden, Verträge und Vertriebsbeziehungen. Dazu kommen Dokumentationen, Qualitätsvorgaben, Freigabeprozesse und Erfahrungswissen. Für Menschen entsteht daraus mit der Zeit ein belastbares Gesamtbild. Ein automatisiertes System sieht zunächst nur einzelne Datensätze, nebeneinander abgelegt.

Genau hier führt eine verbreitete Hoffnung in die Irre: Ein Agent müsse nur an die vorhandenen Datenquellen angeschlossen werden, dann werde er schon nützlich. Tabellen lesen kann ein System. Etwas anderes ist es, zu verstehen, was ein Unternehmen unter Umsatz, Deckungsbeitrag, terminkritischem Auftrag oder Eskalationsfall versteht. Der Engpass liegt deshalb selten im Sprachmodell. Er liegt in einer betrieblichen Wirklichkeit, die nur teilweise beschrieben ist. Ohne formalisierten Zusammenhang entsteht keine belastbare Automatisierung. Es entsteht eine anspruchsvolle Form des Ratens.

Die Rückkehr der Bedeutungsebene

Darum tauchen derzeit so viele neue Begriffe auf: Kontextschicht, Kontext-Engine, Kontext-OS, Ontologie. Die Wörter mögen modisch klingen. Der Gedanke dahinter ist es nicht. Gemeint ist eine Ebene, die verstreute Datenbestände mit ihrer betrieblichen Bedeutung verbindet. Erst Geschäftsdefinitionen, Rollen, Zuständigkeiten, Regeln und reale Abläufe machen aus Daten ein Bild, das Maschinen verlässlich lesen können.

Unternehmen versuchen, genau diese Bedeutungsebene formal abzubilden. Produkte werden mit Komponenten verknüpft, Maschinen mit Fertigungsschritten, Kunden mit Verträgen, Entscheidungen mit Zuständigkeiten. Aus losen Datenpunkten wird ein Beziehungsgefüge. Ein Maschinenstillstand ist dann kein isolierter Eintrag mehr, sondern Teil eines Zusammenhangs: Welche Aufträge sind betroffen? Welche Liefertermine geraten unter Druck? Wer muss entscheiden? Menschen erfassen solche Verbindungen oft intuitiv. Maschinen brauchen dafür eine Beschreibung.

Neu ist dieser Gedanke nicht. In der Wissensmodellierung gibt es Ontologien seit langem. Neu ist der wirtschaftliche Druck, solche Strukturen unternehmensweit aufzubauen. Microsoft beschreibt seine Ontologie in Fabric IQ als Vorschaufunktion, mit der Entitätstypen, Beziehungen, Eigenschaften und weitere Regeln nach dem Geschäftsvokabular eines Unternehmens definiert werden können. Palantir versteht seine Ontology als operative Schicht, die digitale Bestände mit ihren Entsprechungen in der realen Organisation verbindet – von Anlagen und Produkten bis zu Kundenaufträgen und Finanztransaktionen. Beide Ansätze laufen auf dasselbe hinaus: Daten müssen im betrieblichen Zusammenhang modelliert werden.

Was das für den Mittelstand bedeutet

Für den deutschen Mittelstand ist das keine abstrakte Debatte. Die Frage stellt sich sehr konkret. Viele Unternehmen stehen technologisch keineswegs am Anfang. ERP-Systeme strukturieren Aufträge und Materialflüsse, Produktionsdaten werden laufend erfasst, Maschinenparks sind digital angebunden. In vielen Betrieben reicht die operative Digitalisierung weiter, als es die öffentliche Debatte vermuten lässt.

Die Schwachstelle liegt daher meist nicht bei der Datenerfassung. Sie liegt dort, wo Daten in einen belastbaren Zusammenhang gebracht werden müssten. Typisch für mittelständische Strukturen ist, dass relevantes Wissen über mehrere Systeme und Köpfe verteilt ist. Das ERP kennt Aufträge, Stücklisten und Bestände. Die Produktionssteuerung kennt Maschinen, Taktzeiten und Auslastung. Das CRM kennt Kunden, Verträge und Vertriebsbeziehungen. Hinzu kommen technische Dokumentationen, Qualitätsvorgaben, Prozessbeschreibungen und das Erfahrungswissen langjähriger Mitarbeiter. Menschen fügen das mit Routine zusammen. Ein automatisiertes System sieht zunächst getrennte Informationen. An dieser Stelle fällt die Entscheidung: Bleibt künstliche Intelligenz ein Hilfsmittel für Auswertungen, oder wird sie zu einem System, das operative Entscheidungen vorbereiten kann?

Die Debatte über Kontextschichten, Ontologien und semantische Datenmodelle zielt genau auf diese Lücke. Daten müssen mit Geschäftslogik verbunden werden: Produkte mit Komponenten, Maschinen mit Fertigungsschritten, Kunden mit Lieferverträgen, Entscheidungen mit Zuständigkeiten. Erst dann leistet ein Agent mehr als die Wiedergabe einzelner Kennzahlen. Dann meldet ein System einen Maschinenstillstand nicht bloß als Ereignis. Es ordnet ein, welcher Auftrag betroffen ist, welche Liefertermine unter Druck geraten und wer handeln muss.

Gerade für den Mittelstand sind die Voraussetzungen dafür oft besser als in großen, stark zergliederten Organisationen. Prozesse sind häufig klarer, Verantwortlichkeiten direkter, Produkte und Fertigungsabläufe genauer bekannt. In vielen Unternehmen lässt sich sehr präzise sagen, welche Maschine welches Bauteil fertigt, welche Toleranzen gelten und welche Kunden an bestimmten Abläufen hängen. Dieses Wissen ist vorhanden. Das Problem ist seine Form. Ein Teil steckt in IT-Systemen, ein anderer in Dokumenten, ein weiterer in den Köpfen erfahrener Mitarbeiter. Solange dieser Zusammenhang unbeschrieben bleibt, können Maschinen damit wenig anfangen.

Die Konsequenz ist schlicht. Die nächste Phase der Digitalisierung dreht sich nicht in erster Linie um noch mehr Datenspeicherung. Sie dreht sich um die systematische Beschreibung der eigenen Wertschöpfung. Unternehmen müssen ihre Begriffe, Prozesse, Zuständigkeiten und Abhängigkeiten so ordnen, dass daraus eine belastbare, maschinenlesbare Struktur entsteht. Der Hebel liegt oft nicht im nächsten KI-Werkzeug, sondern in der disziplinierten Modellierung des eigenen Betriebs.

Vom Analysewerkzeug zum operativen System

Hier verläuft die Trennlinie. Solange künstliche Intelligenz Abfragen formuliert, Texte zusammenfasst oder Berichte verdichtet, bleibt sie ein Werkzeug. Sobald sie Prioritäten erkennen, Risiken einordnen oder Entscheidungen vorbereiten soll, reicht bloßer Datenzugang nicht mehr aus. Das System muss wissen, welche Beziehungen gelten, welche Ausnahmen zählen und welche Regeln Vorrang haben.

Dass Plattformanbieter diese Lücke inzwischen offen ansprechen, ist aufschlussreich. Microsoft erläutert bei seinen Data Agents ausdrücklich, dass Beispielabfragen und vorgegebene Logiken nötig sind, damit das System Fragen konsistent und kontextbezogen beantwortet. Der Befund bleibt derselbe: Rechenleistung allein trägt nicht. Der fachliche Zusammenhang muss sauber beschrieben sein.

Für Unternehmen beginnt damit vor allem eine organisatorische Arbeit. Sie müssen festlegen, welche Kennzahl gilt, welche Quelle Vorrang hat, welche Sonderfälle dokumentiert werden und wer diese Ordnung pflegt. Das klingt unspektakulär. Genau dort entscheidet sich aber, ob aus einem KI-System ein belastbares Arbeitsmittel wird.

Konsequenz

Die nächste Stufe der Automatisierung scheitert kaum an mangelnder Sprachgewandtheit der Modelle. Die Bruchstelle liegt dort, wo Unternehmen ihre eigene Wirklichkeit unpräzise beschrieben haben. Eine Kontextschicht ist deshalb kein weiteres Zauberwort aus der Produktwelt der KI-Anbieter. Sie ist maschinenlesbare Organisation.

Für den Mittelstand steckt darin keine ferne Zukunftsfrage, sondern eine betriebliche Aufgabe mit erheblicher Tragweite. Seine Stärke lag immer in der präzisen Organisation realer Wertschöpfung. Genau diese Organisationsleistung muss jetzt in eine Form übersetzt werden, die auch digitale Systeme verstehen. Wer diesen Schritt geht, schafft die Grundlage für verlässliche Agenten im Unternehmen. Wer ihn auslässt, beschleunigt mit leistungsfähiger KI vor allem die bestehende Unordnung.